|

|

来源:中科院文献情报中心分区表 | 编辑:CVer

2020年12月4日,中科院文献情报中心分区表首次发布消息,称将推出《国际期刊预警名单》,具体名单将采用定性与定量相结合的方法确定。“定性”应该是基于专家评价和口碑之类来定,具有较大的不确定性。而“定量”则明确指出根据期刊载文量、作者国际化程度、拒稿率、论文处理费、期刊超越指数、自引率和撤稿信息综合评判。

2020年12月31日,发布了首次预警名单。

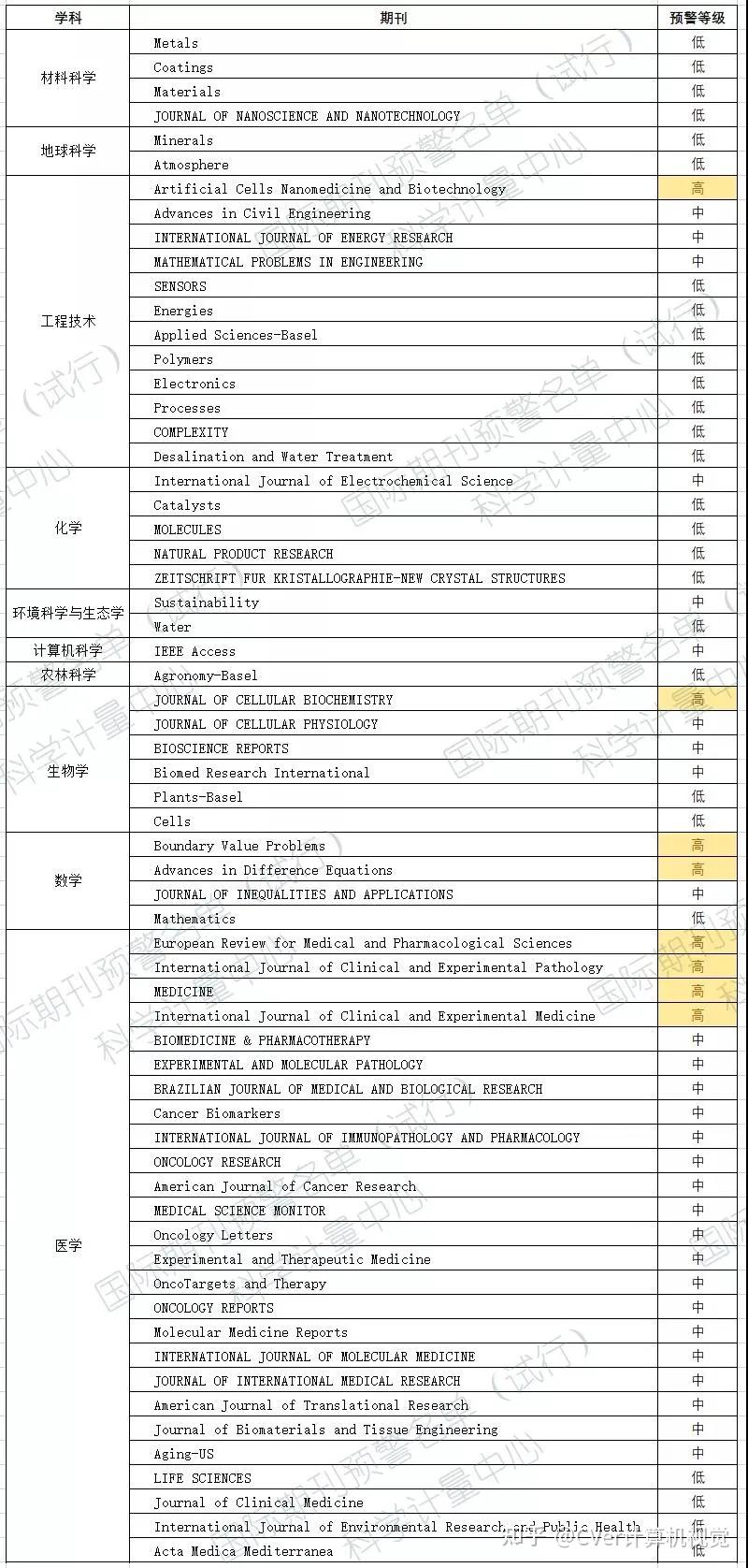

然而就在前几天,2021年12月31日中国科学院文献情报中心-期刊分区表团队发布了2021年度《国际期刊预警名单(试行)》。期刊预警不是论文评价,更不是否定预警期刊发表的每项成果。预警期刊旨在提醒科研人员审慎选择成果发表平台、提示出版机构强化期刊质量管理。2021年度《国际期刊预警名单(试行)》

https://earlywarning.fenqubiao.com/early-warning-journal-list-2021.html

下面是2020年的目录,大家可以对照一下。注意,2020年的国际期刊预警名单(试行)中计算机科学学科中,IEEE Access 赫然在列(独一份),不过在2021 年《国际期刊预警名单(试行)》已经被剔除了。不知道这一举动,会不会影响部分高校自家的"预警黑名单"变动。

PS:Sensors 期刊也被剔除了

https://earlywarning.fenqubiao.com/early-warning-journal-list-2020.html

CVer-Transformer交流群

建了CVer-Transformer交流群!想要进Transformer学习交流群的同学,可以直接加微信号:CVer6666。加的时候备注一下:Transformer+学校/公司+昵称,即可。然后就可以拉你进群了。

强烈推荐大家关注CVer知乎账号和CVer微信公众号,可以快速了解到最新优质的CV论文。

推荐阅读

清华提出DAT:具有可变形注意力的视觉Transformer

哈工大提出SANet:探索多对比度MR图像超分辨率的可分离注意力

Pale Transformer:新的视觉ViT主干

视觉Transformer的PyTorch实现合集!多种ViT变体!

SPT+LSA:用于小规模数据集的视觉Transformer

中科院提出SimViT:探索带有滑动窗口的简单视觉Transformer

涨点神器!ELSA:增强视觉Transformer的局部自注意力

LVT:具有增强自注意力的Lite视觉Transformer

level视觉的高效Transformer和图像预训练

FAIR提出MaskFeat:自监督视觉预训练的Masked特征预测

屠榜目标跟踪!SwinTrack:Transformer跟踪的简单而强大的基线

Mask2Former来了!用于通用图像分割的 Masked-attention Mask Transformer

清华提出:最新的计算机视觉注意力机制(Attention)综述!

国产硬核!AlphaRotate:基于TensorFlow的旋转目标检测基准

Swin Transformer夺得ICCV 2021最佳论文!中国学者拿下“半壁江山”!

为何Transformer在计算机视觉中如此受欢迎?

Transformer一脚踹进医学图像分割!看5篇MICCAI 2021有感

深度学习中的 Attention 机制总结与代码实现(2017-2021年 |

|